Для людей, которые не знакомы с программированием, создание веб-парсера может оказаться сложной задачей. К счастью, программное обеспечение для парсинга веб-страниц доступно как программистам, так и непрограммистам. Программное обеспечение для парсинга веб-страниц — это специально разработанное программное обеспечение для получения соответствующих данных с веб-сайтов. Эти инструменты полезны для всех, кто хочет каким-либо образом получить данные из Интернета. Эта информация записывается в локальный файл на компьютере или в базу данных. Это метод автономного сбора данных для Интернета. Мы представляем список из 31 лучшего бесплатного инструмента для парсинга веб-страниц.

30+ лучших инструментов для парсинга веб-страниц

Отобранный список лучших инструментов для парсинга веб-страниц можно найти здесь. Этот список содержит как коммерческие инструменты, так и инструменты с открытым исходным кодом, а также ссылки на соответствующие веб-сайты.

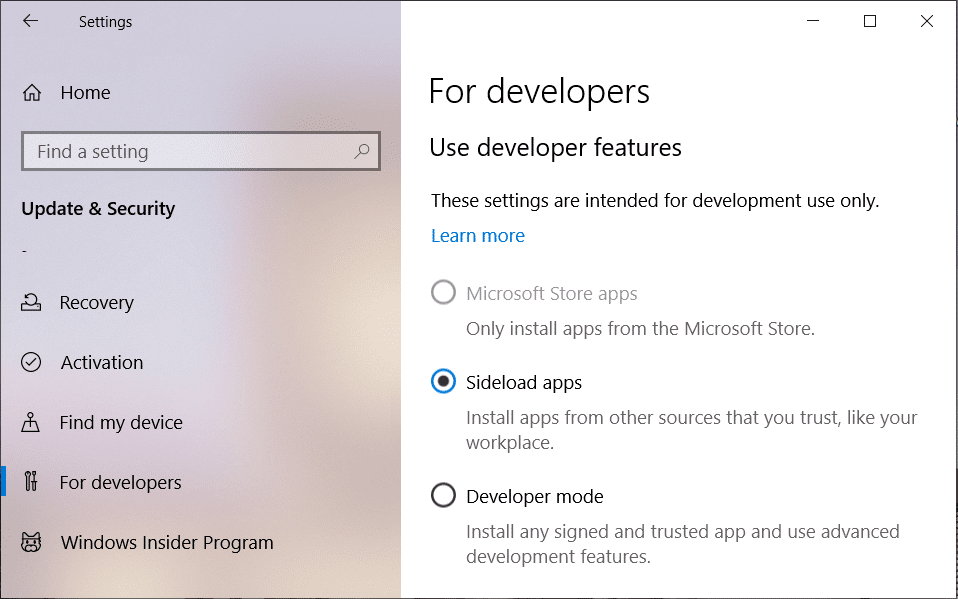

1. Перехитрить

Перехитрить — это надстройка Firefox, которую легко установить из магазина дополнений Firefox.

- Этот инструмент для очистки данных упрощает сбор контактов из Интернета и по электронной почте.

- В зависимости от ваших требований у вас будет три варианта покупки этого продукта.

- Pro

- Expertи

- Предприятие издания имеются.

- Получение данных с сайтов с помощью Outwit Hub не требует знаний программирования.

- Вы можете начать парсинг сотен веб-страниц одним нажатием кнопки «Исследование».

2. ПарезеХаб

ParseHub — еще один из лучших бесплатных инструментов для парсинга веб-страниц.

- Перед загрузкой данных очистите текст и HTML.

- Это так же просто, как выбрать данные, которые вы хотите извлечь, с помощью нашего сложного веб-скребка.

- Это один из лучших инструментов для сбора данных, поскольку он позволяет хранить собранные данные в любом формате для дальнейшего анализа.

- Удобный графический интерфейс

- Этот инструмент для очистки Интернета позволяет автоматически собирать и сохранять данные на серверах.

Читайте также: 16 лучших расширений для блокировки рекламы для Chrome

3. Апифай

апифай — это еще один из лучших инструментов для очистки веб-страниц и автоматизации, который позволяет вам создать API для любого веб-сайта со встроенными прокси-серверами для жилых помещений и центров обработки данных, которые упрощают извлечение данных.

- Apify заботится об инфраструктуре и выставлении счетов, позволяя разработчикам зарабатывать пассивные деньги, создавая инструменты для других.

- Некоторые из доступных разъемов Zapier, Интегромат, Кебоолаи Эйрбайт.

- В Apify Store есть готовые решения для парсинга популярных веб-сайтов, таких как Instagram, Facebook, Twitter и Google Maps.

- JSON, XML, CSV, HTML и Excel — это структурированные формы, которые можно загрузить.

- HTTPS, геолокационный таргетинг, умная ротация IP-адресов и Google SERP прокси — это все функции Apify Proxy.

- Бесплатно 30-дневная пробная версия прокси с Платформенный кредит в размере 5 долларов США.

4. Свалка

Свалка используется более чем 2,000 фирмами, и они полагаются на этот уникальный API, работающий на базе apilayer. Возможно, вам также будет интересно прочитать о 25 лучших бесплатных инструментах для веб-сканирования. Это один из лучших бесплатных инструментов для парсинга веб-страниц.

- Использует пул IP-адресов по всему миру, состоящий из 35 миллионов центров обработки данных.

- Позволяет одновременно выполнять множество запросов API.

- Оба формата ЗАЩИТНЫЙ дешифрование и JavaScript рендеринг поддерживается.

- Доступны как бесплатные, так и платные варианты.

- Scrapestack — это онлайн-скрапинг REST API который работает в режиме реального времени.

- API Scrapestack позволяет парсить веб-страницы за миллисекунды, используя миллионы прокси-IP-адресов, браузеров и CAPTCHA.

- Запросы на парсинг веб-страниц могут быть отправлены из более чем 100 различных мест по всему миру.

5. ФМинер

Для Windows и Mac OS, FMMiner — это популярная программа онлайн-скрапинга, извлечения данных, сканирования экрана сканирования, макросов и веб-поддержки.

- Данные могут быть собраны из сложных для сканирования динамических Веб-2.0 веб-сайтов.

- Позволяет создать проект извлечения данных с помощью простого в использовании визуального редактора.

- Использует комбинацию структур ссылок, раскрывающихся меню и сопоставления шаблонов URL-адресов, чтобы вы могли копаться в веб-страницах.

- Вы можете использовать сторонние службы автоматической декапчи или ручной ввод на целевой веб-сайт. ЗАЩИТНЫЙ защита.

6. Секвентум

Ассоциация Секвентум — это надежный инструмент больших данных для получения достоверных онлайн-данных. Это еще один из лучших бесплатных инструментов для парсинга веб-страниц.

- По сравнению с альтернативными решениями извлечение онлайн-данных становится быстрее.

- Используя эту функцию, вы можете переключаться между несколькими платформами.

- Это один из самых мощных веб-парсеров для развития вашей компании. Он содержит простые функции, включая визуальный редактор «укажи и щелкни».

- Ассоциация выделенный веб-API поможет вам в разработке веб-приложений, позволяя выполнять веб-данные прямо с вашего веб-сайта.

Читайте также: Топ-15 лучших бесплатных IPTV-плееров

7. Агентство

Агенти — это программа для очистки данных, извлечения текста и оптического распознавания символов, использующая роботизированную автоматизацию процессов.

- Эта программа позволяет вам повторно использовать все обработанные данные для аналитических целей.

- Вы можете создать агента всего несколькими щелчками мыши.

- После выполнения задания вы получите электронное письмо.

- Он позволяет подключиться к Dropbox и используйте безопасный Ftp.

- Все журналы активности для всех событий доступны для просмотра.

- Помогает вам улучшить успех вашей компании.

- Позволяет легко реализовывать бизнес-правила и пользовательскую логику.

8. Импорт.ио

Импортируя данные с определенной веб-страницы и экспортируя их в CSV, приложение для очистки веб-страниц import.io помогает вам формировать наборы данных. Это также один из лучших инструментов для парсинга веб-страниц. Ниже приведены особенности этого инструмента.

- Веб-формы/логины просты в использовании.

- Это одно из лучших решений для очистки данных для использования API и вебхуки для интеграции данных в приложения.

- Вы можете получить представление с помощью отчетов, диаграмм и визуализаций.

- Извлечение данных следует планировать заранее.

- Облако Import.io позволяет хранить данные и получать к ним доступ.

- Взаимодействие с Интернетом и рабочие процессы можно автоматизировать.

9. Вебз.ио

Webz.io позволяет вам сканировать сотни веб-сайтов и сразу же получать доступ к структурированным данным в режиме реального времени. Это также один из лучших бесплатных инструментов для парсинга веб-страниц.

Вы можете получить организованные машиночитаемые наборы данных в форматах JSON и XML.

- Это дает вам доступ к исторические каналы которые охватывают данные за более чем десять лет.

- Позволяет вам иметь доступ к большой базе данных каналов данных без необходимости платить какие-либо дополнительные расходы.

- Вы можете использовать расширенный фильтр, чтобы проводить подробный анализ и подавать наборы данных.

Читайте также: 15 лучших бесплатных провайдеров электронной почты для малого бизнеса

10. Скребушка

Царапающая сова — это платформа для парсинга веб-страниц, простая в использовании и экономичная.

- Основная цель Scrape Owl — очистить любые типы данных, включая электронную коммерцию, доски объявлений о вакансиях и списки объектов недвижимости.

- Перед извлечением материала можно запустить кастомный JavaScript.

- Вы можете использовать местоположения, чтобы обойти местные ограничения и получить доступ к местному контенту.

- Обеспечивает надежную функцию ожидания.

- Поддерживается полностраничный рендеринг JavaScript.

- Это приложение можно использовать непосредственно на Таблица Google.

- Предлагает бесплатную пробную версию на 1000 кредитов, чтобы опробовать услугу перед покупкой членства. Нет необходимости использовать кредитную карту.

11. Скребущая пчела

скребок — это API для парсинга веб-страниц, который отвечает за настройки прокси-сервера и автономных браузеров.

- Он может выполнять Javascript на страницах и менять прокси для каждого запроса, поэтому вы можете читать необработанный HTML, не попадая в черный список.

- Также доступен второй API для извлечения результатов поиска Google.

- Поддерживается рендеринг JavaScript.

- Имеет функцию автоматической ротации прокси.

- Это приложение можно использовать непосредственно на Таблицы Google.

- Для использования программы необходим веб-браузер Chrome.

- Он идеально подходит для Amazon выскабливание.

- Это позволяет вам собирать результаты Google.

12. Яркие данные

. — это ведущая в мире онлайн-платформа данных, предлагающая экономичное решение для масштабного сбора общедоступных веб-данных, легкого преобразования неструктурированных данных в структурированные и обеспечения превосходного качества обслуживания клиентов, сохраняя при этом полную прозрачность и соответствие требованиям.

- Он является наиболее адаптируемым, поскольку поставляется с готовыми решениями, его можно расширять и настраивать.

- Новое поколение Bright Data Сборщик данных обеспечивает автоматизированный и персонализированный поток данных на единой информационной панели, независимо от размера коллекции.

- Он открыт 24 часа в сутки, семь дней в неделю и предлагает помощь клиентам.

- от Электронная коммерция тенденции от данных социальных сетей до информации о конкурентах и исследований рынка, наборы данных адаптированы к потребностям вашего бизнеса.

- Вы можете сосредоточиться на своем основном бизнесе, автоматизировав доступ к надежным данным в вашей отрасли.

- Он наиболее эффективен, поскольку использует решения без кода и использует меньше ресурсов.

- Самый надежный, с данными самого высокого качества, более длительным временем безотказной работы, более быстрой передачей данных и лучшим обслуживанием клиентов.

13. API-скребок

Вы можете использовать Скребок API инструмент для обработки прокси, браузеров и CAPTCHA.

- Этот инструмент обеспечивает непревзойденную скорость и надежность, позволяя создавать масштабируемые веб-парсеры.

- Вы можете получить HTML-код с любой веб-страницы с помощью одного вызова API.

- Его легко настроить, поскольку все, что вам нужно сделать, это отправить запрос GET с вашим Ключ API и URL до Конечная точка API.

- Позволяет JavaScript чтобы было легче визуализироваться.

- Он позволяет вам настроить тип запроса и заголовки для каждого запроса.

- Ротация прокси с географическим местоположением

Читайте также: 20 лучших приложений для отслеживания мобильных телефонов

14. Декси Интеллект

Dexi умный — это онлайн-приложение для парсинга, которое позволяет превратить любой объем веб-данных в быструю коммерческую ценность.

- Этот онлайн-инструмент парсинга позволяет вам сэкономить деньги и время вашей компании.

- Он повысил производительность, точность и качество.

- Это обеспечивает максимально быстрое и эффективное извлечение данных.

- Оно имеет крупномасштабная система сбора знаний.

15. Диффбот

Diffbot позволяет быстро получить множество важных фактов из Интернета.

- С помощью экстракторов искусственного интеллекта вы сможете извлекать точные структурированные данные из любого URL-адреса.

- С вас не будет взиматься плата за трудоемкий анализ веб-сайта или запрос вручную.

- Для построения полного и точного образа каждого объекта происходит объединение множества источников данных.

- Вы можете извлечь структурированные данные из любого URL Экстракторы ИИ.

- Доступно Краулбот, вы можете масштабировать извлечение до десятков тысяч доменов.

- Ассоциация График знаний Эта функция предоставляет Интернету точные, полные и глубокие данные, необходимые BI для предоставления значимой информации.

16. Поток данных

Поток данных — это технология, которая позволяет вам получать материалы социальных сетей со всего Интернета.

- Это один из лучших онлайн-скребков, который использует обработку естественного языка для получения важных метаданных.

- Kibana и Elasticsearch используются для обеспечения интегрированного полнотекстового поиска.

- На основе алгоритмов поиска информации, интегрированного удаления шаблонов и извлечения контента.

- Построен на основе отказоустойчивой инфраструктуры, обеспечивающей высокую доступность информации.

Читайте также: Как заблокировать и разблокировать веб-сайт в Google Chrome

17. Мозенда

Вы можете извлекать текст, фотографии и PDF-материалы с веб-страниц, используя Мозенда.

- Вы можете использовать выбранный вами инструмент или базу данных Bl для сбора и публикации данных в Интернете.

- Это один из лучших инструментов онлайн-скрапинга для организации и форматирования файлов данных для публикации.

- Благодаря интерфейсу «укажи и щелкни» вы можете создать агенты парсинга веб-страниц за считанные минуты.

- Для сбора веб-данных в режиме реального времени используйте Секвенсор заданий и Запросить блокировку возможности.

- Управление счетами и обслуживание клиентов являются одними из лучших в отрасли.

18. Расширение Data Miner для Chrome

Парсинг веб-страниц и сбор данных стали проще благодаря Плагин для браузера Data Miner.

- Он имеет возможность сканирования нескольких страниц, а также динамического извлечения данных.

- Выбор данных может осуществляться различными способами.

- Он исследует информацию, которая была очищена.

- Собранные данные можно сохранить в виде файла CSV.

- Локальное хранилище используется для хранения очищенных данных.

- Дополнение для Chrome Веб скребок извлекает данные с динамических сайтов.

- Файлы Sitemap можно импортировать и экспортировать.

Читайте также: 28 лучших программ для копирования файлов для Windows

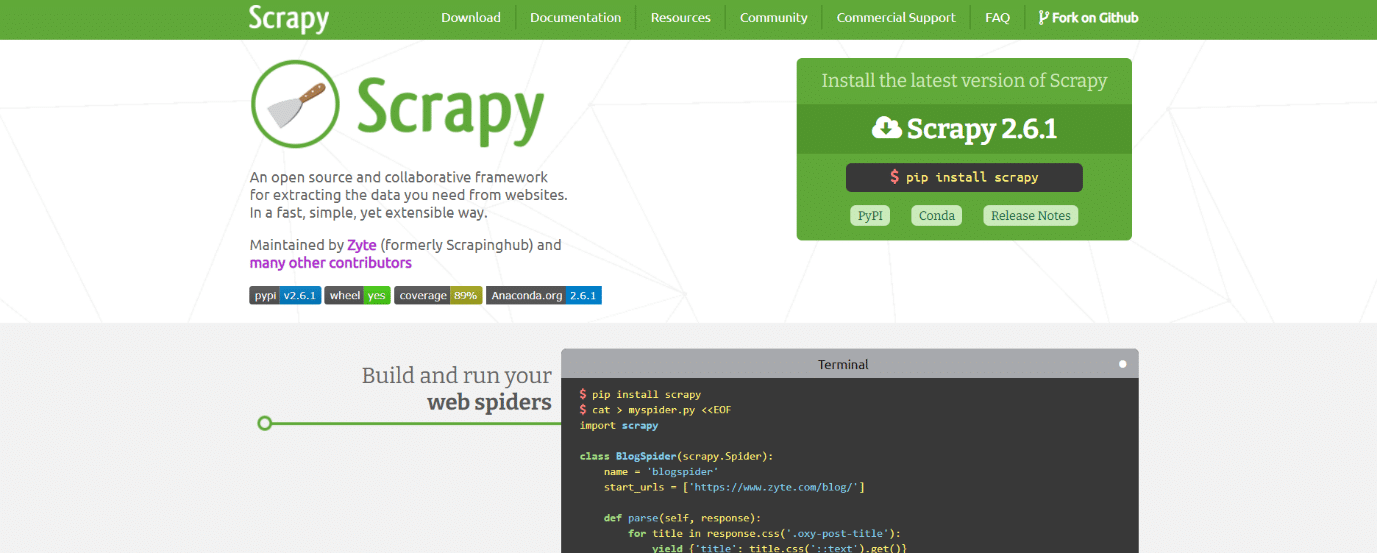

19. Скрепи

Scrapy также является одним из лучших инструментов для парсинга веб-страниц. Это основанная на Python платформа онлайн-скрапинга с открытым исходным кодом для создания веб-скраперов.

- Он предоставляет вам все инструменты, необходимые для быстрого извлечения данных с веб-сайтов, их анализа и сохранения в структуре и формате по вашему выбору.

- Этот инструмент для очистки данных необходим, если у вас есть большой проект по очистке данных и вы хотите сделать его максимально эффективным, сохраняя при этом большую гибкость.

- Данные могут быть экспортированы в виде JSON, CSVили XML.

- Поддерживаются Linux, Mac OS X и Windows.

- Он разработан на основе технологии асинхронных сетей Twisted, которая является одной из его ключевых особенностей.

- Scrapy отличается простотой использования, обширной документацией и активным сообществом.

20. Облако ScrapeHero

ScrapeHero взяла свои многолетние знания в области веб-сканирования и превратила их в экономичные и простые в использовании готовые сканеры и API для сбора данных с таких сайтов, как Amazon, Google, Walmart и других.

- Облачные сканеры ScrapeHero включают в себя автоматически чередующиеся прокси и возможность одновременного запуска нескольких сканеров.

- Вам не нужно загружать или изучать, как использовать какие-либо инструменты или программное обеспечение для сбора данных, чтобы использовать ScrapeHero Облако.

- Облачные сканеры ScrapeHero позволяют мгновенно собирать данные и экспортировать их в JSON, CSVили Excel форматов.

- Клиенты планов ScrapeHero Cloud Free и Lite получают помощь по электронной почте, а все остальные планы получают приоритетную услугу.

- Облачные сканеры ScrapeHero также можно настроить в соответствии с конкретными требованиями клиентов.

- Это веб-скребок на основе браузера, который работает с любым веб-браузером.

- Вам не нужны никакие знания программирования или разработка парсера; это так же просто, как щелкнуть, скопировать и вставить!

Читайте также: Исправить ошибку Discord JavaScript при запуске

21. Сборщик данных

Сборщик данных — это бесплатное онлайн-приложение для очистки данных, которое собирает данные с одной веб-страницы и сохраняет их в виде файлов CSV или XSL.

- Это расширение для браузера, которое преобразует данные в удобный табличный формат.

- Установка плагина Chrome требует использования Google Chrome браузер.

- В бесплатной версии вы можете очищать 500 страниц каждый месяц; но если вы хотите очистить больше страниц, вам необходимо перейти на один из дорогих планов.

22. Визуальный веб-риппер

Визуальный веб-потрошитель — это инструмент автоматического сбора данных с веб-сайтов.

- Структуры данных собираются с веб-сайтов или результатов поиска с помощью этого инструмента.

- Вы можете экспортировать данные в CSV, XMLи Excel файлы и имеет удобный интерфейс.

- Он также может собирать данные с динамических веб-сайтов, например тех, которые используют AJAX.

- Вам просто нужно настроить несколько шаблонов, а обо всем остальном позаботится веб-скребок.

- Visual Web Ripper предлагает варианты планирования и даже отправляет вам электронное письмо, если проект терпит неудачу.

23. Октопарс

Осьминога — это удобное приложение для очистки веб-страниц с визуальным интерфейсом. Это один из лучших бесплатных инструментов для парсинга веб-страниц. Ниже приведены особенности этого инструмента.

- Его интерфейс «укажи и щелкни» упрощает выбор информации, которую вы хотите получить с веб-сайта. Octoparse может обрабатывать как статические, так и динамические веб-страницы благодаря AJAX, JavaScript, файлы cookie и другие возможности.

- Теперь доступны расширенные облачные сервисы, позволяющие извлекать большие объемы данных.

- Собранную информацию можно сохранить как TXT, CSV, HTMLили XLSX файлы.

- Бесплатная версия Octoparse позволяет создать до 10 сканеров; однако планы платного членства включают такие функции, как API и большое количество анонимных IP-прокси, которые ускорят извлечение данных и позволят загружать большие объемы данных в режиме реального времени.

Читайте также: Заархивируйте или разархивируйте файлы и папки в Windows 10

24. Веб Харви

ВебХарви'с Visual Web Scraper имеет встроенный браузер для сбора данных с онлайн-сайтов. Это также один из лучших инструментов для парсинга веб-страниц. Вот несколько особенностей этого инструмента.

- Он предлагает интерфейс «укажи и щелкни», который упрощает выбор предметов.

- Преимущество этого парсера заключается в том, что вам не нужно писать какой-либо код.

- CSV, JSONи XML файлы можно использовать для сохранения данных.

- Также возможно сохранить его в SQL база данных. WebHarvey имеет функцию многоуровневого сбора категорий, которая может собирать данные со страниц списков, отслеживая каждый уровень связей категорий.

- Регулярные выражения можно использовать с инструментом очистки Интернета, что дает вам дополнительную свободу.

- Вы можете настроить прокси-серверы, чтобы скрыть свой IP-адрес при получении данных с веб-сайтов, что позволит вам сохранить определенную конфиденциальность.

25. ПиПаук

ПиПайдер Это также один из лучших бесплатных инструментов для парсинга веб-страниц, который представляет собой веб-сканер на основе Python. Некоторые особенности этого инструмента перечислены ниже.

- Он имеет распределенную архитектуру и поддерживает страницы Javascript.

- Таким образом у вас может быть много сканеров. PySpider может хранить данные на любом сервере по вашему выбору, включая MongoDB, MySQL, RedisИ другие.

- Очереди сообщений, такие как RabbitMQ, бобовое деревои Redis имеются.

- Одним из преимуществ PySpider является его простой пользовательский интерфейс, который позволяет изменять сценарии, отслеживать текущие действия и анализировать результаты.

- Информацию можно загрузить в форматах JSON и CSV.

- PySpider — это Интернет-скребок, на который следует обратить внимание, если вы работаете с пользовательским интерфейсом на основе веб-сайта.

- Он также работает с веб-сайтами, которые используют много AJAX.

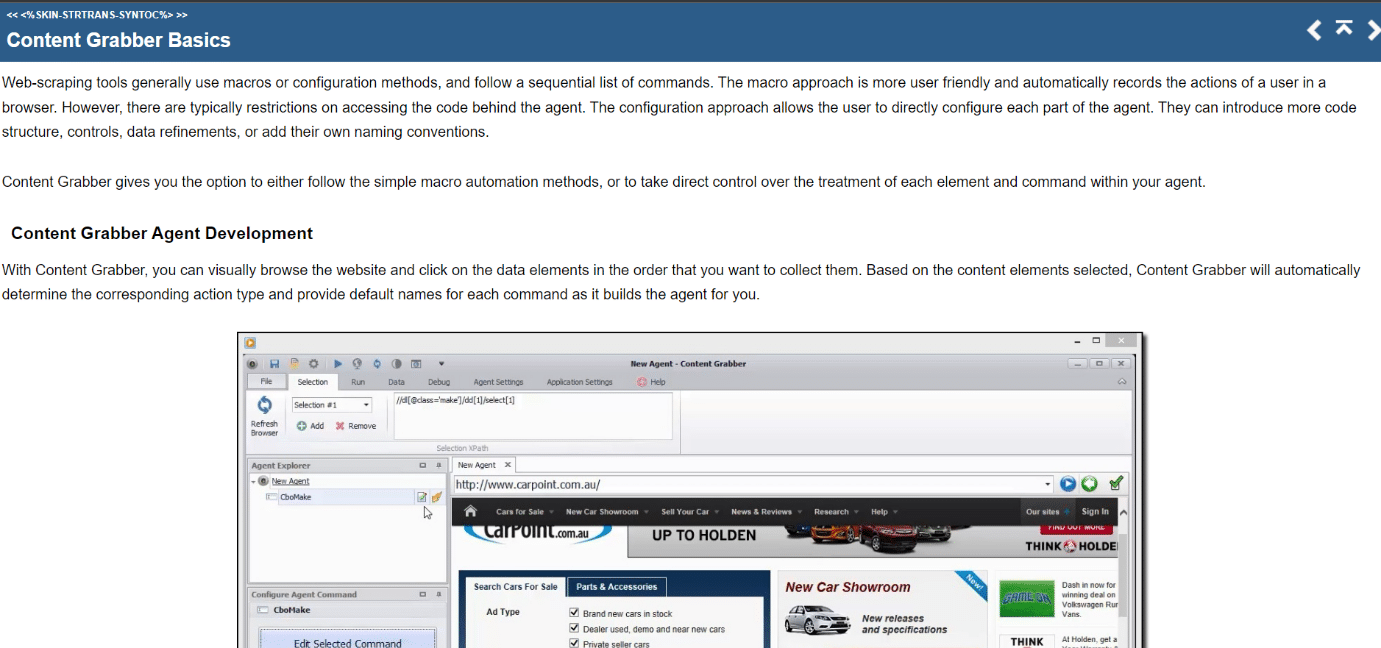

26. Захват контента

Контент-граббер — это визуальный онлайн-инструмент для парсинга с простым в использовании интерфейсом «укажи и щелкни» для выбора элементов. Ниже приведены особенности этого инструмента.

- CSV, XLSX, JSON и PDF — это форматы, в которых можно экспортировать данные. Для использования этого инструмента необходимы средние навыки программирования.

- Благодаря пользовательскому интерфейсу возможны нумерация страниц, безграничная прокрутка страниц и всплывающие окна.

- Она также имеет AJAX/Яваскрипт обработка, решение для проверки кода, поддержка регулярных выражений и ротация IP-адресов (с использованием Ноходо).

Читайте также: 7-Zip против WinZip против WinRAR (лучший инструмент для сжатия файлов)

27. Кимурай

Кимурай — это платформа очистки веб-страниц Ruby для создания парсеров и извлечения данных. Это также один из лучших бесплатных инструментов для парсинга веб-страниц. Вот несколько особенностей этого инструмента.

- Он позволяет нам очищать веб-страницы, созданные на JavaScript, и взаимодействовать с ними прямо из коробки с помощью Безголовый Chromium/Firefox, PhantomJSили базовые HTTP-запросы.

- Он имеет синтаксис, аналогичный Scrapy, и настраиваемые параметры, включая настройку задержки, ротацию пользовательских агентов и заголовки по умолчанию.

- Он также взаимодействует с веб-страницами с помощью Водосвинка фреймворк для тестирования.

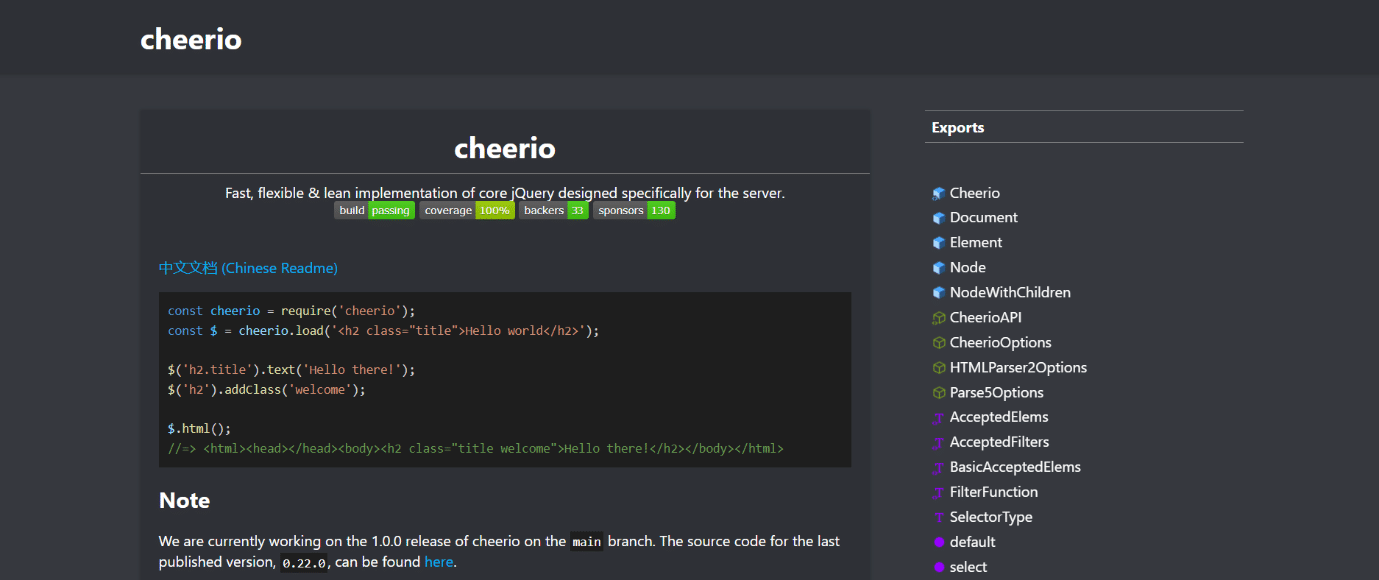

28. Черио

Ваше здоровье — еще один из лучших инструментов для парсинга веб-страниц. Это пакет, который анализирует документы HTML и XML и позволяет работать с загруженными данными, используя синтаксис jQuery. Ниже приведены особенности этого инструмента.

- Если вы разрабатываете веб-скребок JavaScript, Cheerio API предоставляет быстрый выбор для анализа, изменения и отображения данных.

- Он не отображает вывод в веб-браузере, примените CSS, загрузите внешние ресурсы или запустите JavaScript.

- Если какая-либо из этих функций требуется, вам следует посмотреть PhantomJS or JSDom.

Читайте также: Как включить или отключить JavaScript в вашем браузере

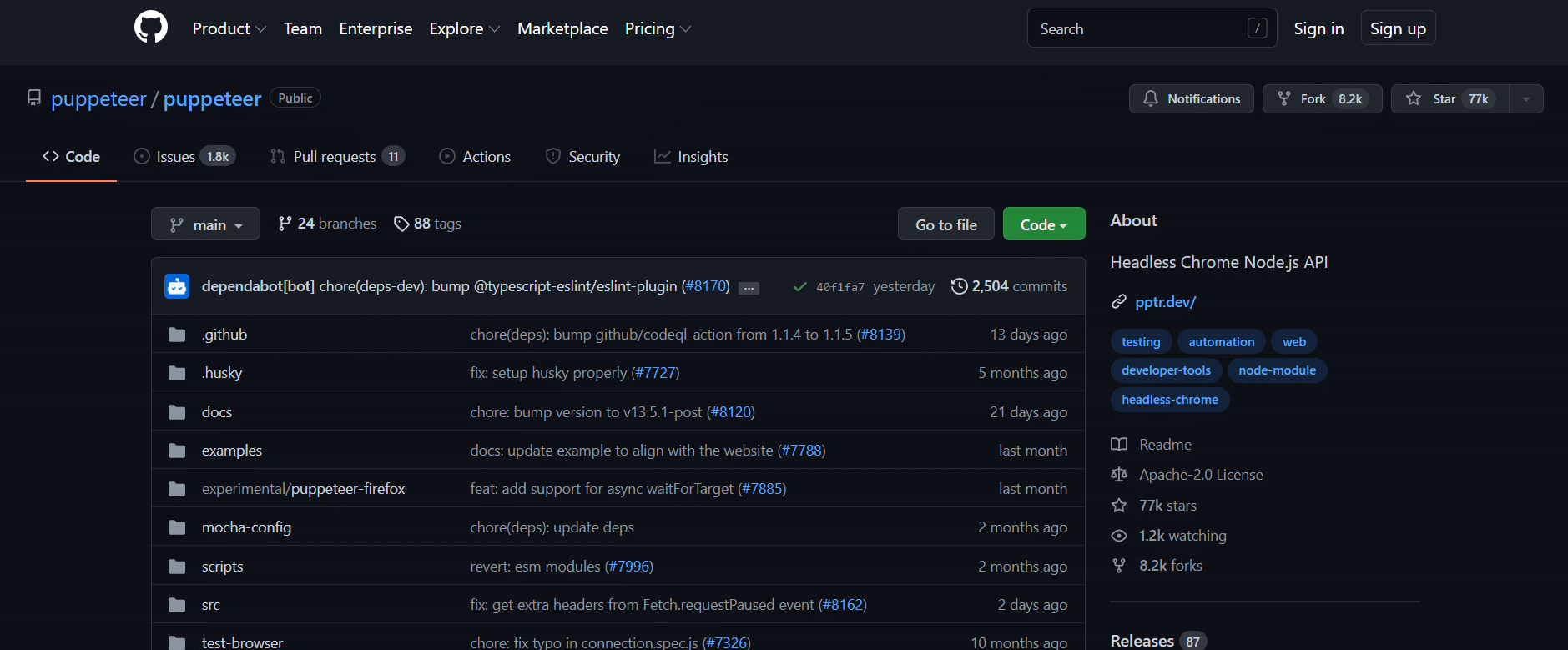

29. Кукловод

кукольник — это пакет Node, который позволяет управлять автономным браузером Chrome от Google с помощью мощного, но простого API. Некоторые особенности этого инструмента перечислены ниже.

- Он работает в фоновом режиме, выполняя команды через API.

- Безголовый браузер — это браузер, который способен отправлять и получать запросы, но не имеет графического пользовательского интерфейса.

- Puppeteer — правильное решение задачи, если искомая информация генерируется с использованием комбинации Данные API и Javascript код.

- Вы можете имитировать действия пользователя, печатая и нажимая в тех же местах, что и он.

- Puppeteer также можно использовать для создания снимков экрана веб-страниц, которые по умолчанию отображаются при открытии веб-браузера.

30. Драматург

Драматург — это библиотека Microsoft Node, предназначенная для автоматизации браузера. Это еще один из лучших бесплатных инструментов для парсинга веб-страниц. Вот несколько особенностей этого инструмента.

- Он предлагает компетентную, надежную и быструю кроссбраузерную веб-автоматизацию.

- Playwright был призван улучшить автоматическое тестирование пользовательского интерфейса, устранив нестабильность, увеличив скорость выполнения и предоставив представление о том, как работает браузер.

- Это современное приложение для автоматизации браузера, которое во многом сравнимо с Puppeteer и поставляется с предустановленными совместимыми браузерами.

- Его основным преимуществом является кроссбраузерность, поскольку он может запускать Chromium, WebKitи Firefox.

- Драматург объединяется с Докер, Azure, Трэвис CI, и AppVeyor на регулярной основе.

Читайте также: Исправление зависания uTorrent при подключении к узлам

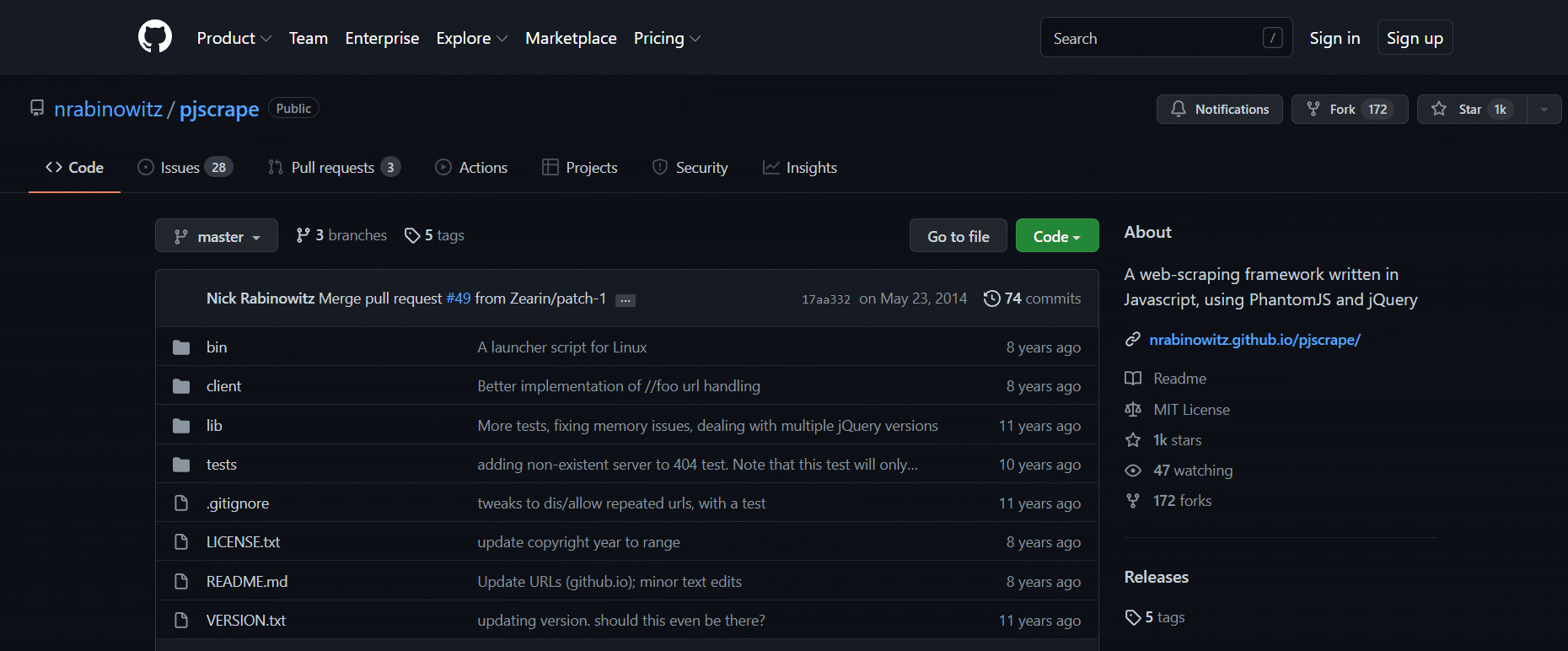

31. ПиДжейСкрап

ПиДжейскрэп — это набор инструментов для онлайн-скрапинга на основе Python, который использует Javascript и JQuery. Ниже приведены особенности этого инструмента.

- Он предназначен для работы с PhantomJS, поэтому вы можете очищать сайты из командной строки в полностью визуализированном контексте с поддержкой Javascript без необходимости использования браузера.

- Это означает, что вы можете получить доступ не только к DOM но также переменные и функции Javascript, а также AJAX-загруженный контент.

- Функции парсера оцениваются в контексте всего браузера.

Рекомендуется:

Мы надеемся, что это руководство было полезно лучшие инструменты для парсинга веб-страниц. Дайте нам знать, какой инструмент вам удобен. Продолжайте посещать нашу страницу, чтобы узнать больше интересных советов и приемов, и оставляйте свои комментарии ниже.